SPM - Theoretischer Hintergrund

SPM – statistical parametric mapping – ist eine

Software zum Berechnen von fMRI und PET-Daten und wurde vom Functional

Imaging Laboratory des Institute for

Cognitive Neurology,

Universität London entwickelt. Es handelte sich dabei nicht um ein

eigenständiges Programm sondern vielmehr um eine MATLAB –Applikation, die unter

einer eigenen Oberfläche läuft. SPM ist kostenlos im Internet unter http://www.fil.ion.ucl.ac.uk/spm/

erhältlich, MATLAB ist eine mathematische Software, die kommerziell vertrieben

wird und für das Arbeiten mit SPM unentbehrlich ist.

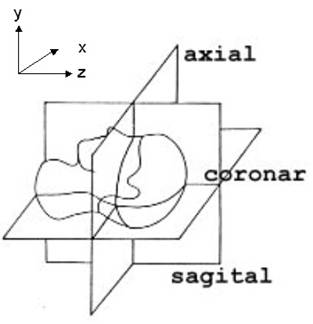

SPM benötigt die Daten in

folgender Orientierung:

X-Achse: Zunahme von Links nach Rechts

Z-Achse: Zunahme von Inferior nach Superior

Die Analyse der fMRI-Daten unterteilt sich in mehrere Arbeitsschritte.

Im

ersten Komplex, dem Daten-Preprocessing werden die

Daten für die statistische Auswertung vorbereitet, von Bewegungsartefakten, und

Signalsprüngen befreit und in den stereotaktischen Raum nach Talairach übertragen. Zum Preprocessing gehören:

![]() Coregistrierung

& Realignment

Coregistrierung

& Realignment

![]() Normalisierung

Normalisierung

![]() Smoothen

Smoothen

Dem Preprocessing folgt die

Definition des statistischen Modells und die statistische Analyse der Daten:

![]() Erstellung des statistischen Modells

Erstellung des statistischen Modells

![]() Statistische Auswertung

Statistische Auswertung

![]() graphische Darstellung der Ergebnisse

graphische Darstellung der Ergebnisse

Für die

korrekte graphische Darstellung der Ergebnisse ist es notwendig, neben den

eigentlichen fMRI-Daten auch noch ein hochaufgelösten

3D-MPR-Datensatz aufzunehmen.

1.

Coregistrierung

Es gibt

2 Formen des Coregistrierens: zum einen wird im

Rahmen der Bewegungskorrektur coregistriert:

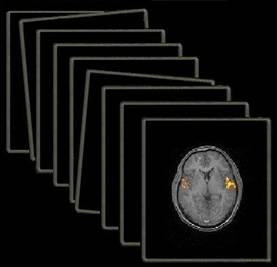

![]() jede fMRI Messung hat bis zu 120 oder mehr Einzelbilder

jede fMRI Messung hat bis zu 120 oder mehr Einzelbilder

![]() daraus wir ein Gesamtbild

errechnet

daraus wir ein Gesamtbild

errechnet

![]() durch Bewegungsartefakte sind Einzelbilder

aber nicht immer Deckungsgleich

durch Bewegungsartefakte sind Einzelbilder

aber nicht immer Deckungsgleich

![]() durch die Coregistrierung

wird jedes Einzelbild im Raum genau in seiner Position definiert dadurch werden

die Verschiebungen der Einzelbilder errechnet

durch die Coregistrierung

wird jedes Einzelbild im Raum genau in seiner Position definiert dadurch werden

die Verschiebungen der Einzelbilder errechnet

![]() Anhand dieser Daten wird die

Bewegungskorrektur durchgeführt

Anhand dieser Daten wird die

Bewegungskorrektur durchgeführt

Die

zweite Form des Coregistrierens dient der

Fusionierung der Bilder unterschiedlicher Modalitäten wie fMRI-EPI-Bildern

und 3D-MPR-Bildern.

2.

Realign (Bewegungskorrektur)

![]() das erste Bild der Zeitserie dient

dabei als Referenzbild

das erste Bild der Zeitserie dient

dabei als Referenzbild

![]() alle anderen Bilder werden daran ausgerichtet

und zur Deckung gebracht (Rigid Body-Transformation)

alle anderen Bilder werden daran ausgerichtet

und zur Deckung gebracht (Rigid Body-Transformation)

![]() Verschiebungen bis zu 2mm und 0,5° können von

der Software korrigiert werden

Verschiebungen bis zu 2mm und 0,5° können von

der Software korrigiert werden

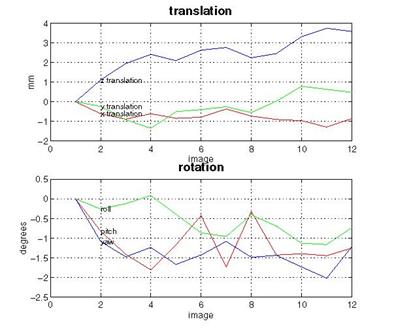

Die

Bewegungskorrektur hat für die Auswertung eine elementare Bedeutung da schon

geringe Bewegungsartefakte Aktivierungen vortäuschen können, die von den

gesuchten Aktivierungen nicht unterschieden werden können. Auf Grund der Dauer

der Untersuchung (mehrere Minuten) ist eine 100%ig Fixierung des Kopfes jedoch

nicht möglich. Hinzu kommen noch Artefakte, die durch physiologische Parameter

(z.B. Atmung / Herzschlag), die Messung und das Paradigma (z.B.

stimuluskorrelierte Bewegungen) bedingt sind. Deshalb können nur Datensätze zur

Auswertung heran gezogen werden, deren Bewegungsartefakte nicht größer als 2mm

in den 3 Raumachsen bzw. 0.5° Rotation um diese Achsen sind. SPM zeigt diese

Daten nach der Bewegungskorrektur an à immer

kontrollieren!

![]() die nebenstehenden Daten zeigen deutliche

Bewegungsartefakte >2mm und >0,5°, die durch die Software nicht

korrigierbar sind.

die nebenstehenden Daten zeigen deutliche

Bewegungsartefakte >2mm und >0,5°, die durch die Software nicht

korrigierbar sind.

![]() dieser Datensatz muss von der weiteren

Auswertung ausgeschlossen werden, da nicht mehr mit Sicherheit ausgeschlossen

werden kann, dass die gefundenen Aktivierungen nicht auf die nicht

korrigierbaren Bewegungen zurück geführt werden können

dieser Datensatz muss von der weiteren

Auswertung ausgeschlossen werden, da nicht mehr mit Sicherheit ausgeschlossen

werden kann, dass die gefundenen Aktivierungen nicht auf die nicht

korrigierbaren Bewegungen zurück geführt werden können

3.

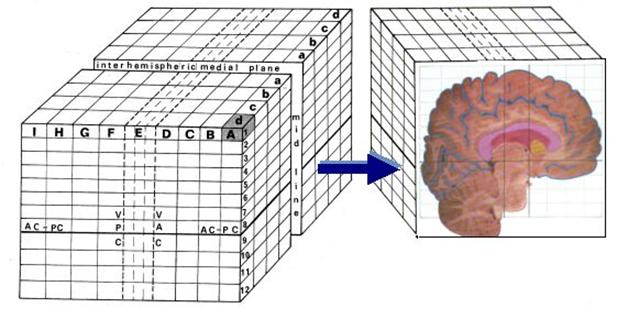

Normalisierung

Die individuelle Anatomie ist zum

Teil sehr unterschiedlich. Durch die Normalisierung wird die individuelle

Anatomie auf einen standartisierten Raum, das Talairach - Koordinaten-System, angepasst (nichtlineare

Transformation in den Standardraum nach Talairach)

Somit liegen die gleichen anatomische Strukturen immer an den selben Koordinaten.

Dadurch ist der Vergleich der Ergebnisse innerhalb und zwischen

Untersuchungs-Gruppen möglich. Für die Einzelfallanalyse ist die Normalisierung

nicht notwendig, nicht normalisierte Daten sind aber nicht direkt vergleichbar.

Durch die Normalisierung kommt es zu Abweichungen von der individuelle Anatomie

à für

genaue individuelle anatomische Lokalisation (z.B. in der Neurochirurgie) keine

Normalisierung verwenden.

4.

Smoothen (Glätten)

Durch

das Smoothen werden große Signalsprünge innerhalb der

Datensätze eliminiert (geglättet). Ziel ist, das Signal-Rausch-Verhältnis zu

verbessern. Dadurch können die echten Aktivierungen besser von Störsignalen

abgegrenzt werden.

Beim smoothen wird die Verknüpfung eines Bildpunktes mit

benachbarten Bildpunkten bewertet. Die Festlegung der Bewertung der

Nachbarschaft erfolgt durch eine Filtermaske (Kernel).

5.

Statistisches Modell

und Auswertung

Mit dem Smoothen ist das Daten-Preprocessing abgeschlossen. Nun wird das statistische

Model (Design-Matrix) erstellt. Hier fließen die Information des Paradigmas ein

(Anzahl der Bilder, Interscanninterval, Anzahl und

Länge der ON/OFF-Phasen, Anzahl der Trails usw.) und es werden Hoch- und Tiefpassfilter

definiert. Die Statistik basiert auf einer Voxel by

Voxel t-/F-Test-Statistik., d.h. für jedes Voxel wird ein univariater

Standarttest auf Signifikanz durchgeführt.

6.

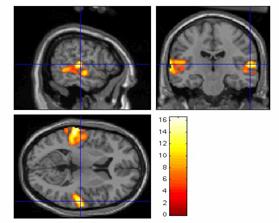

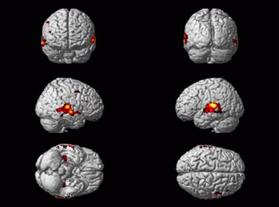

Graphische

Ergebnisdarstellung

Um die Ergebnisse graphisch darstellen zu können, müssen

noch die mitgemessenen 3D-MPR-Datensätze das entsprechende Preprocessing

durchlaufen. Dabei werden die anatomisch hochaufgelösten Daten mit den

fMRI-EPI-Daten coregistriert (d.h. sie werden

einander „angepasst“ und nachfolgend auch normalisiert, sofern auch die

fMRI-EPI-Daten normalisiert wurden). Danach können die Aktivierungen den

anatomischen Bildern überlagert werden und genau anatomisch lokalisieren

werden.

Es gibt 2 Möglichkeiten der Darstellung:

Volume-Rendering:

Surface-Rendering

In den folgenden SPM-Kapiteln

soll beispielhaft eine einfache Single-Subjektanalyse gezeigt werden um einen

Einstieg in die Auswertung zu geben. Erfahrungsgemäß tut sich gerade der SPM-Anfänger recht schwer die ersten Datensätze

auszuwerten. Es bedarf schon ein wenig Zeit und leistungsfähiger Computer um

tiefer in die Auswertung vorzudringen. Ziel von www.fmri-easy.de

ist diesen Einstig etwas zu erleichtern. Ausführliche weiterführende

Informationen zu diesem Thema gibt es in englischer Sprache unter: http://www.fil.ion.ucl.ac.uk/spm/